Konuğum Atakan Özkaya'dan: Çaya batırılan madlenin izinde

ChatGPT gibi LLM’ler de Proust’un çaya madlen batırdığında tüm çocukluğunu, annesinin ona verdiği iyi geceler öpücüklerini hatırlaması gibi ek bir hafızadan beslenebilir.

Bu hafta konuk yazarım Atakan Özkaya, kendisi bana çoook sevdiğim dostum Rıdvan Akca tarafından “tam zamanında” tanıştırılan bir dost.

Bizim işimiz scouting yani futbolda oyuncu izleme, girişimcilik dünyasında da bu yüzden zaman zaman gözlem yapıyorum. Maçlara gidip diyeyim, insanları izliyorum. İzlediğim oyunculardan en yeteneklilerinden biri Atakan ve madlen.

Aynı zamanda kendisi postamıza 3 arkadaşını kazandırdığı için birkaç yazı önce üçbaşı rütbesi almaya hak kazandı. Sizler de 10X Girişimci’yi okumayı seviyorsanız ve arkadaşlarınıza önerirseniz beni çok mutlu edersiniz :)

RAG 101 tadında, Proust’un izinden, Fransızların gurme tatlılarından madeleine tadında bir yazı için hazırız galiba… Mikrofon Atakan’da!

UBZ is the king! Umut beni değerli bültenine yazmam için davet etti ve ben de bu sayede muhteşem ötesi bir cumartesi akşamı aktivitesi edinmiş oldum: 10X Girişimci Umut’un bültenine bir yazı hazırlamak!

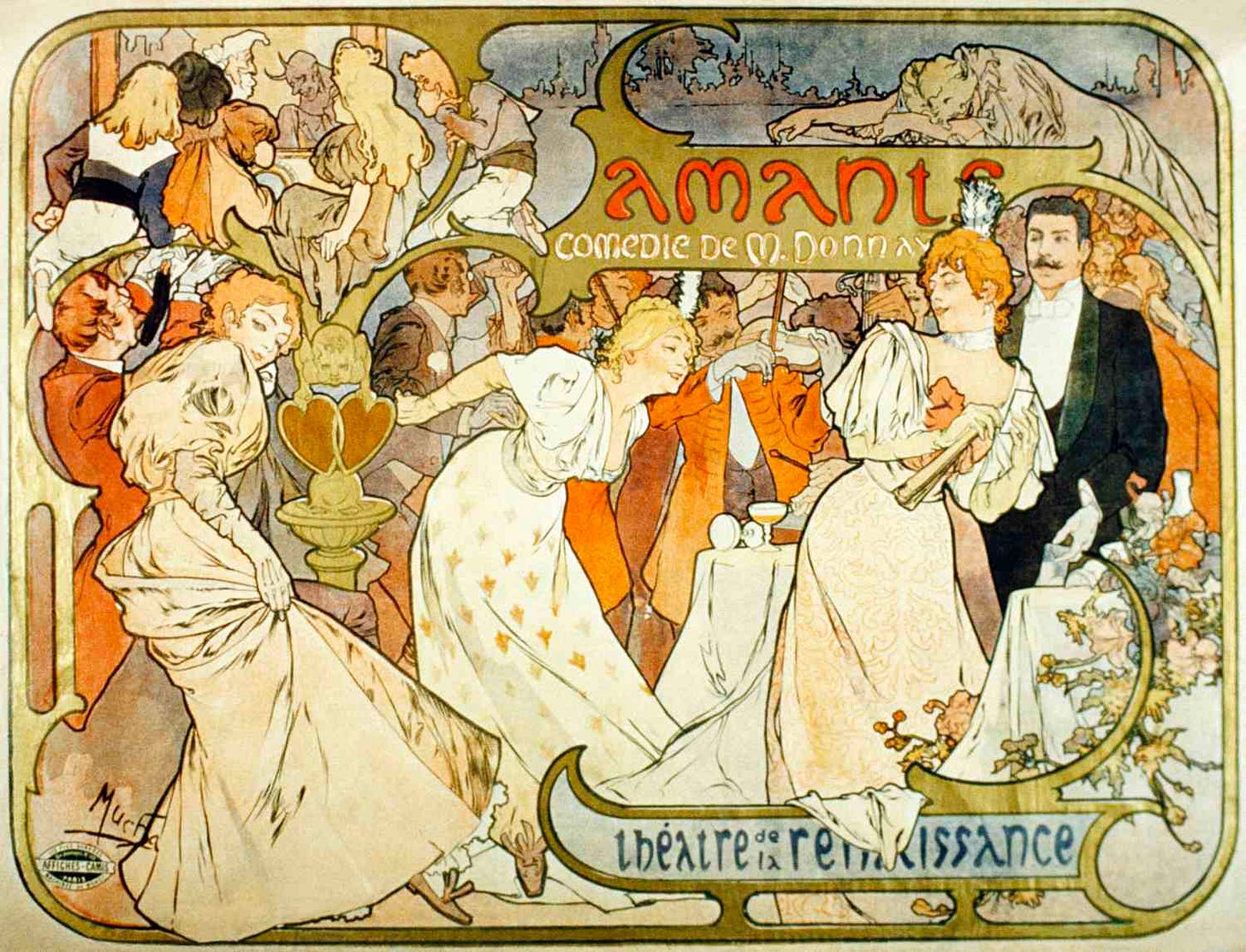

Yaklaşık bir asır önce, Marcel Proust roman türünde yazılabilecek en önemli esere imza attı. Beethoven’ın 9. senfonisinin müzikte, Manet’in “Berthe Morisot” portresinin tüm resim sanatında olabileceklerin sınırını çizmesi gibi; Proust da zamanla aşınmayan inanılmaz kitabı Kayıp Zamanın İzinde’si ile aşılamayan bir eser yarattı. 20. yüzyılın Paris’ini anlatırken satır aralarında yitirilen zamanın nasıl yakalanacağını gösterdi.

Bu muazzam romanın başlarında anlatıcı, çaya bir madlen batırır ve geri dönüşü olmayan bir süreç başlar:

Uzun yıllardır, akşamları yatışımın tiyatrosu, dramı dışında Combray’ye ait her şey benim için yok olmuşken, bir kış günü eve döndüğümde, üşümüş olduğumu gören annem, alışık olmadığım halde, biraz çay içmemi önerdi. Önce istemedim, sonra, bilmem neden fikir değiştirdim. Annem, birini gönderip, küçük madlen denilen, bir tarak midyesinin oluklu çenetleri arasında biçimlendirilmiş gibi görünen o kısa, tombul keklerden aldırdı. Az sonra, o kasvetli günün ve iç karartıcı yarının beklentisiyle bunalmış bir halde, yaptığım şeye dikkat etmeden, yumuşasın diye içine bir parça madlen attığım çaydan bir kaşık alıp ağzıma götürdüm. Ama içinde kek kırıntıları bulunan çay damağıma değdiği anda irkilerek, içimde olup biten olağanüstü şeye dikkat kesildim. Sebebi hakkında en ufak bir fikre sahip olmadığım, soyutlanmış, harikulade bir haz, benliğimi sarmıştı. Bir anda, hayatın dertlerini önemsiz, felaketleri zararsız, kısalığını boş kılmış, aşkla aynı yöntemi izleyerek, benliğimi değerli bir özle doldurmuştu; daha doğrusu, bu öz, benliğimde değildi, benliğimin ta kendisiydi. Kendimi vasat, sıradan ve ölümlü hissetmiyordum artık. Bu yoğun mutluluk nereden gelmiş olabilirdi bana?… Sonra ansızın o hatıra karşımda beliriverdi. Bu tat, Combray’de pazar sabahları (pazarları Missa saatinden önce evden çıkılmadığından), Léonie Halamın, ‘günaydın’ demeye odasına gittiğimde, çayına ya da ıhlamuruna batırıp bana verdiği bir parça madlenin tadıydı…

Peki bu hatırlama 21. yüzyılda bizim için ne ifade etmekte? 2020 yılında bir grup araştırmacı bir makale yayınladı:

Retrieval-Augmented Generation for Knowledge-Intensive NLP Tasks*

Detaylarına inmeden önce mini adımlar atarak kavramlara bir bakalım. Günümüzde “Büyük Dil Modelleri”ni duymayan pek kalmadı sanıyorum. Bir anlığına gözünüzü kapatıp internetteki tüm verinin boyutunu hayal etmeye çalışın.

Tüm makaleler, web sayfaları ve daha niceleri… Sınırsız dijital bir labirentte iç içe geçmiş sonsuz büyüklükte bir kütüphane.

Bir insanın milyonlarca ömrü olsa dahi bunun tüm sayfaları okumaya yetmemesinin önüne nasıl geçebiliriz?

Evet, bir çözümü var. İlk iş insan zihnindeki nöronların yapısını sanal dünyada taklit etmek. Ardından bizim öğrenme süreçlerimize benzer olarak bu nöronları eğitmek. Ortaya büyük bir fonksiyon ve milyarlarca parametre çıkması…

Bingo! Sizin yazdığınız kelimelere göre olası yeni kelimeleri tahmin eden bir program.

İsminden de anlaşılacağı gibi bu modeller gerçekten büyük, çünkü terabaytlarca metin verisiyle eğitiliyor. Bu sayede de her sorunuza cevap verebiliyorlar. Eğer sorduğunuz soru için yeterince fazla miktarda hakiki veriyle eğitilmişlerse verdikleri yanıt da doğru oluyor. Aksi halde, hayal gücü geniş bir insanın kurabileceği gibi yanlış yanıtlar da elde edebiliyoruz.

Bu modellerin inanılmaz faydalı olduğunu biliyoruz ama sınırları neler?

İlki ve en önemlisi, “cut-off date” de denilen belirli bir tarihe kadar veri içermeleri. En güçlü modellerden biri olan GPT-4 için bu tarih Nisan, 2023. Son 8-9 ayda neler olup bittiğine dair pek bir fikirleri yok aslında.

İkincisi, gördüğü halüsinasyonlar. Biraz önce şu soruyu sordum: “Kıtlama çay sağlığa çok iyi gelir değil mi?”

Aldığım yanıt ise “Kıtlama çayı, genellikle Doğu Karadeniz bölgesinde yetişen ve geleneksel olarak tüketilen bir bitki çayıdır. Yaprakları kıtlanarak kurutulduğu için bu ismi alır…”

Benim cut-off date’im olan 27 Şubat tarihi itibariyle böyle bir bitki çayı türünün var olmadığını düşünüyorum. Kıtlama şeker, Erzurum’da çok meşhur ancak bildiğimiz gibi böyle bir bitki çayı yok. Peki ya “kıtlanarak kurutmaya” ne demeli…

Bu durumu nasıl çözebiliriz?

Proust’un çaya madlen batırdığında tüm çocukluğunu, annesinin ona verdiği iyi geceler öpücüklerini hatırlaması gibi bir yöntem ile!

Peki ama modellerin geçmişi veya hafızası var mı? Tabii ki yok ama biz hafıza yerine modele “anımsama” işlemini gerçekleştirebileceği bir metinsel kaynak sunsak? BUUUM!

Bitki çayları ile ilgili farklı dillerden birkaç kitap ve makale seçelim ve kolayca erişilebilecek şekilde depolayalım. Sorduğumuz soruya göre bir arama işlemi gerçekleşsin ve bu kitaplardaki ilgili bölümlerden güç alan model bize bir cevap versin. Bir örnek ile açıklayalım:

Kullanıcının sorgusu: “Yeşil çay nedir?”

Modele aslında giden prompt:

“Yeşil çay nedir?” sorusuna aşağıdaki bağlama dayanarak cevap ver:

“Yeşil çay, Camellia sinensis bitkisinin yapraklarından elde edilen bir çay türüdür. Diğer çay türleri gibi siyah ve oolong çayı da aynı bitkiden yapılır; ancak işlenme şekilleri farklıdır. Yeşil çay, oksidasyon sürecinden geçmez veya çok az geçer, bu da onun daha açık renkli olmasını ve daha hafif bir tadı olmasını sağlar.”

Bu sayede bir bilgi kaynağı olarak büyük dil modellerini kullanmaya başlayabiliyoruz! Soruyu ve bilgiyi sağladıktan sonra geriye yalnızca bunu güzel bir dille ifade edebilecek bir aracıya ihtiyaç duyuyoruz. Muhteşem özenle yazılmış bir ders kitabından tahtaya çıkıp konu anlatan bir öğretmen gibi. Ders kitabı o kadar iyi ki öğretmenin fazladan herhangi bir katkı sunmasına gerek kalmıyor.

Umut ve Proust

Günümüzde pek kalmayan ama Fransızların La Belle Epoque adını verdiği muazzam yüzyılda meşhur olan bir salon geleneği var. Varlıklı kadınlar, uzun ve doyasıya sohbetlerin hüküm sürdüğü davetler veriyorlar. Entelektüel sınıftan birçok insan katılıp mevcut siyasi durumlar, edebiyat ve müzik hakkında konuşuyor. Bir de her salonda, herkesin gönlünü anında çelen inanılmaz sempati uyandıran ve ayrılır ayrılmaz ardından insanların konuşmaya başladığı unutulmaz insanlar oluyor. Umut’u tanıdığım ilk günden bu yana da tam olarak bu karakterde olduğunu düşünüyorum. Bu insanların sayısı artık çok az. Sahip çıkmalıyız!

İyi ki varsın Umut!